2.1. Поняття інформації та інформаційного процесу

Інформація - об'єкт вивчення та дослідження цілого розділу кібернетики, що називається теорія інформації і займається математичним описом та оцінкою методів передачі, збереження, пошуку і класифікації інформації, а також вивчає і досліджує загальні сторони інформаційних процесів різної природи - технічної (сигнали в електронних схемах), біологічної (біотоки в організмах), економічної, соціальної тощо. Теорія інформації вивчає лише кількісну сторону інформації без семантичного змісту та цінності для отримувача. Аналізом інформаційних потоків займається інформатика - наука, що вивчає та досліджує інформаційні процеси та системи в соціальній сфері, - їх роль, методи побудови, механізм взаємодії на практичну діяльність людини та посилення цієї взаємодії з допомогою засобів обчислювальної техніки.

Інформатика тісно пов'язана з поняттям інформаційних технологій. За визначенням академіка В.М.Глушкова, процеси, де основною продукцією, що переробляється, є інформація, називаються інформаційними технологіями. Причому інформація розглядається поданою в знаковій формі: у вигляді текстів повідомлень, відомостей, вихідних даних, таблиць, графіків, завдань і т.п.

Слово інформація походить від латинського informatio - виклад, роз'яснення, тлумачення, подання, поняття, обізнаність, просвіта. Поняття інформації неодноразово змінювалось, його межі то розширювалися, то звужувалися. Спочатку під цим словом розуміли уявлення, поняття, потім - відомості, передачу повідомлень.

Сучасна наука трактує поняття інформації як окремої самостійної субстанції, яка може передаватись та породжувати новий інформаційний простір. Замічено, що в природі важко провести чітку границю між енергетичними та інформаційними явищами, як і сказати що є первинним дія чи інформація, що поступила. Наприклад удар блискавки в дерево, чи поштовх пасажира при виході з транспорту, що замешкався, можна розглядати не тільки як передачу енергії, а й передачу інформації від одного об'єкта до іншого. Разом з тим будь яке інформаційне повідомлення, наприклад прохання пропустити пасажира при виході, теж буде супроводжуватись енергетичними затратами. Як бачимо існує взаємно-однозначна залежність між передачею енергії та інформації, вони не можуть існувати одна без одної.

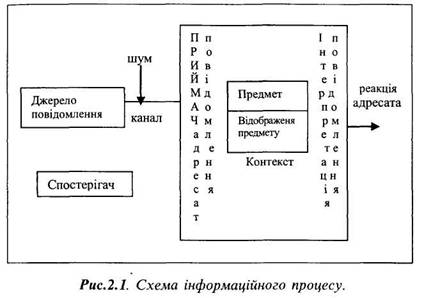

Передача інформації здійснюється за системою, що включає в ідеалі компоненти на рис.2.1.

Як бачимо на рис.2.1 відправник інформаційного повідомлення є джерелом інформації і передає дані по інформаційному каналу, в якому можуть бути присутні шумові ефекти, адресату. Прийом повідомлення є основною ланкою інформаційного процесу і представляє собою відношення: предмет (ім'я, носій інформації) - приймач інформації- відображення предмету інформації - контекст - інтерпретація повідомлення. Якщо погодитись з даною схемою інформаційного процесу, то інформацію можна розглядати як величину або міру, що характеризує різні форми відображення, структурного різнобіччя взаємодіючого

з адресатом джерела повідомлення. Складовою частиною інформаційного повідомлення будемо вважати знак, який визначимо як матеріальний об'єкт, що умовно представляє деякий предмет, явище, зв'язок або відношення предметів, явищ, зв'язків, а також: чуттєвий стан джерела повідомлення.

Самою примітивною формою знака може бути сигнал, що виникає в результаті чуттєвої взаємодії на нервову систему адресата. Саме сигнал є основною ланкою інформаційного процесу в рослинному та тваринному світі, що використовують закладені природженим інстинктом програми поведінки.

Найскладнішою формою знака є символ, що служить основною ланкою інформаційного процесу у всіх галузях діяльності людини, включаючи розумову, соціальну, творчу, технічну, економічну, фінансову, лінгвістичну тощо. Символ як носій інформації включає чотири аспекти: ^>ім'я або предмет (матеріальний носій інформації), ^відображення предмету (предмет, явище, що позначено даним іменем), с>сутність (поняття та знання про предмет чи явище), ^> чуттєве сприймання (інтонація, звукові або візуальні ефекти).

В ході історичного процесу становлення та розвитку інформаційних систем людство створило штучний знак, з метою представлення нформації та автоматизованої обробки її засобами обчислювальної техніки. Штучний знак включає два аспекти: <=>ин'я або предмет

(матеріальний носій інформації), ^сутність ( поняття та знання про предмет чи явище).

В залежності від аспектів відображення та компонентів знака, до яких належить інформаційна величина, розрізняють наступні види інформації:

> прагматична - характеризує цінність повідомлення з точки зору, що орієнтована на отримувача (приймача) інформації, його можливості тощо;

> семантична - оцінює повідомлення з точки зору його сутності та варіантів знань про заданий предмет;

> синтаксична - характеризує оцінку повідомлення отримувачем в межах тих обмежень, які накладаються на комбінації та можливості вживання знаків;

> сигматична - характеризує повідомлення з точки зору відношення позначеного іменем предмету, явища дійсності тощо із знаннями про нього;

> афективна - характеризує повідомлення з точки зору естетичного, емоційного, чуттєвого сприймання інформації на рівні нервової діяльності людини.

В 1948 році американський математик К.Е.Шеннон запропонував ймовірносну теорію інформації, яка отримала назву теорії інформації Шеннона і служить сьогодні основною методологічною базою для дослідження інформаційних процесів в автоматизованих системах обробки даних.

Очевидно що існують повідомлення інформація в яких може суттєво залежати від часу чи терміну отримання приймачем, адже затримка повідомлення змінює його характер. Прикладами може бути прогноз погоди чи штормове попередження. Нормальним є випадок, коли вся інформація в повідомленні поступає вчасно, наприклад бій годинника.

Очевидно, що є повідомлення, інформація яких не залежить від часу і зважаючи на той факт що семантика нас не цікавить в даному випадку, будемо їх вважати знаками. Ці знаки можуть бути вибраними з певними не залежними від часу ймовірностями з деякої кінцевої чи нескінченної множини знаків, що фактично складає словник. Наприклад, слід особливо відзначити приклад з киданням грального кубика, коли ймовірність зустріти потрібний знак Z в будь-який час t співпадає з відносною частотою появи знака Z серед послідовності всіх знаків. Послідовності знаків з такими особливостями називаються шенноновськими повідомленнями, а відправник - шенноновськнм джерелом.

Як бачимо, інформаційну цінність складають повідомлення, які здійснюються не за правилами, розкладом тощо, вони і будуть шенноновськими. Доречно в зв'язку з цим згадати слова Нільса Йонсона: «Той факт, що зло все ще має більш високу інформаційну цінність, ніж добро, - непогана ознака. Вона доводить, що добро є правилом, а зло, навпаки, виключенням з правила».

Шенноновська теорія інформації або кількості інформації, виходить із елементарного альтернативного вибору між двома знаками X та Y, який відповідає прийому повідомлення, що складається з одного двоїчного знака та приймається за одиницю кількості інформації і називається бітом. Слід зазначити, що вісім бітів створюють - байт.

Проблема інформації є однією з найбільш актуальних і фундаментальних в умовах сучасного розвитку науки і техніки. Проте єдиного загального визначення поняття інформації не існує. Це свідчення бурхливого і суперечливого розвитку поняття інформації в науці, який породив велику кількість точок зору на це питання.

Досить часто сутність інформації розглядається через поняття ентропії.

Ентропія - одне з фундаментальних понять, висунутих наукою за останнє століття і трактується як міра енергії, що необхідна для повернення певної системи в певний початковий стан; як міра безпорядку, що має місце в системі, міра невизначеності знань про внутрішню структуру системи.

Н. Вінер підкреслює, що ентропія та інформація пов'язані тому, що характеризують реальну дійсність з точки зору хаосу і впорядкованості. Якщо ентропія - міра хаосу, то інформація - міра впорядкованості. Л.Бріллюен охарактеризував інформацію як негативну ентропію, або негентропію. Низька ентропія означає нестійкий стан, який рано чи пізно перейде шляхом природної еволюції в стійкий стан з високою ентропією.